最新研发模拟人工智能芯片:能效14倍于传统芯片提升语音识别效率

中新网北京8月24日电 (记者 孙自法)国际著名学术期刊《自然》最新发表一篇计算科学论文,研究人员报道了一种能效为传统数字计算机芯片14倍的模拟人工智能(AI)芯片。研究显示,这一由美国IBM研究实验室开发的芯片在语音识别上的效率超过通用处理器,该项技术或能打破当前AI开发中因对算力性能和效率的需求而遇到的瓶颈。

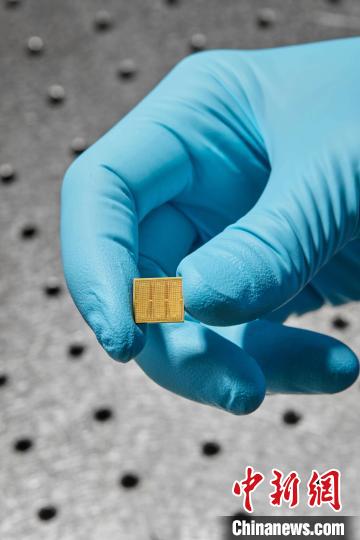

14纳米模拟AI芯片在检测板上(图片来自Ryan Lavine)。施普林格·自然 供图

该论文介绍,随着AI技术的崛起,对能源和资源的需求也随之上升。在语音识别领域,软件升级极大提升了自动转写的准确率,但由于在存储器与处理器之间移动的运算数量不断增加,硬件无法跟上训练和运行这些模型所需的数以百万计的参数。研究人员提出的一个解决办法是使用“存内计算”(CiM,或称模拟AI)芯片。模拟AI系统通过直接在它自己的存储器内执行运算来防止低效,而数字处理器需要额外时间和能源在存储器和处理器之间移动数据。模拟AI芯片预计能极大提升AI计算的能效,但之前对此的实际演示一直缺乏。

研究者手上拿着的14纳米模拟AI芯片(图片来自Ryan Lavine)。施普林格·自然 供图

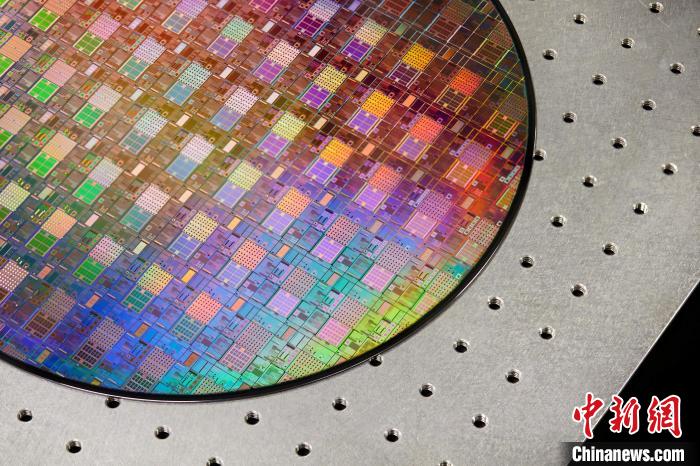

论文第一作者和通讯作者、IBM研究实验室S. Ambrogio和同事开发了一个14纳米的模拟AI芯片,在34个模块(tile)中含有3500万个相变化内存单元。研究团队用两个语音识别软件在语言处理能力上测试了该芯片的效率,这两个软件分别是一个小网络(Google Speech Commands)和一个大网络(Librispeech),并在自然语言处理任务上与行业标准进行对比。小网络的性能和准确率与当前的数字技术相当。对于更大的Librispeech模型来说,该芯片能达到每秒每瓦12.4万亿次运算(Tera Operations),系统性能估计最高能达到传统通用处理器的14倍。

用来制造模拟AI芯片的300毫米晶圆(图片来自Ryan Lavine)。施普林格·自然 供图

《自然》同期发表同行专家的“新闻与观点”文章称,该研究在小模型和大模型中同时验证了模拟AI技术的性能和效率,支持其有望成为数字系统的商业可行的替代选择。(完)

版权声明:凡注明“来源:中国西藏网”或“中国西藏网文”的所有作品,版权归高原(北京)文化传播有限公司。任何媒体转载、摘编、引用,须注明来源中国西藏网和署著作者名,否则将追究相关法律责任。

中国西藏网微博

中国西藏网微博 中国西藏网微信

中国西藏网微信